WWDC19:iOS 13から、サードパーティもTaptic Engineと音が同期する「Core Haptic」が利用可能に #WWDC19

※本サイトは、アフィリエイト広告および広告による収益を得て運営しています。購入により売上の一部が本サイトに還元されることがあります。

Appleが、WWDC19において「Core Haptics」を行い、その内容を公開しています。

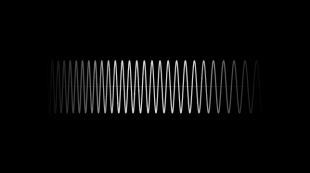

iPhone 6s/6s Plusから3D Touchと共に搭載されたリニアアクチュエータ「Taptic Engine」は、元になっているデータがサウンド波形であることを初めて明らかにしています。

非常に低い1音をTaptic Engineに送ると1振動となりますが、元がサウンド波形であるため、音に近い振動となり機械的には感じません。

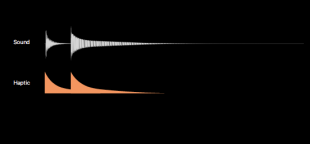

Appleは、これをスピーカーから出る音の波形とTaptic Engineの振動波形を調和させることによる音と触覚とのハーモニーを「Haptic Engine」と呼んでいるそうです。

セッションで初めて気付いたのですが、Apple Payで支払を行う時2種類のトーンと同時に本体が少し振動しています。

この振動は2種類のトーンと同じタイミングで2種類の異なる振動を発動しているそうです。

また、Apple WatchのDigital Crownは、機械式時計を研究した結果、リューズを回すことによって動く歯車から出る音と、歯車が噛み合うことによる振動を再現する方法としてHaptic Engineを使っていることも明らかにしています。

しかも、機械式時計がそうであるように、わざと音と振動を小さくしているのだそうです。

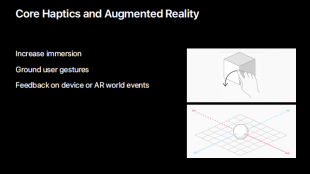

ARで台所にキッチンタイマーを表示したとして、そのARオブジェクトにiPhone 6sを近づけるとタイマーの音が大きくなり、離すとタイマーの音が小さくなるよう仕掛けることで、ARに対する実体感が大幅に増すとデモしています。

Appleは、サウンドによって人間の聴覚を刺激することはとても有効だと説明しています。

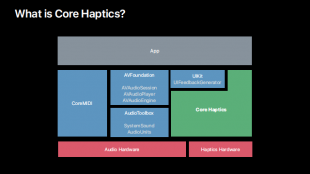

Haptic Engineを使用する「Core Haptic」は、オーディオハードウェアの一部とTaptic Engineを使用します。

対応する端末として、iPhone 8シリーズ、iPhone Xシリーズでサポートされます。

Appleは、Human Interface Guidelinesに「Haptics」を追加しています。

Core Hapticsは、ARゲームで実装するとより現実感が増すとして推奨しています。

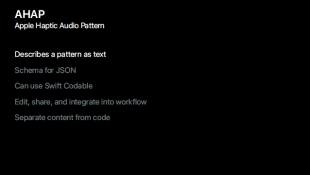

実装するにあたり「Apple Haptic Audio Pattern」(AHAP)について説明し、JSON型ファイルフォーマットを作成し、オーディオファイルや画像など他のファイルリソースと同様に、Xcodeプロジェクトに追加して使用します。