Appleの機械学習サンプルデーターを使ってカメラ認識を体験できるカメラアプリ「DeepVision for Core ML」を試す

※本サイトは、アフィリエイト広告および広告による収益を得て運営しています。購入により売上の一部が本サイトに還元されることがあります。

Pedro Jose Pereira Vieitoが、iPhone/iPad用カメラアプリ「DeepVision for Core ML」を、App Storeにて販売を開始していたので試してみました。

Appleの機械学習サンプルデーターを使ってカメラ認識を体験できるカメラアプリです。

MacのFaceTimeカメラを使う「DeepVision for Core ML」も販売されています。

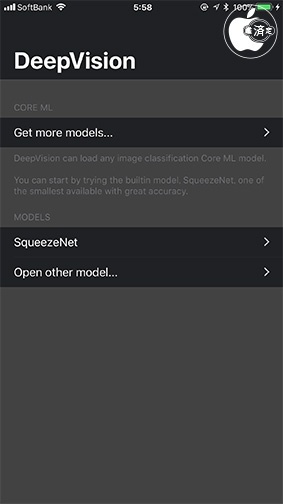

アプリを起動して、Get more modelsをタップすると、Appleのデベロッパー情報「Machine Learning」にアクセスします。

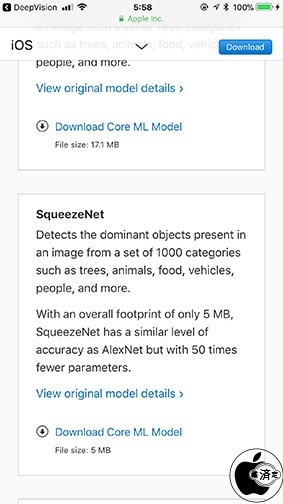

サイトの下にWorking with Modelsが用意されていて、そこでDownload Core ML Modelをアプリ内にダウンロードして読み込ませます。

MobileNet、SqueezeNet、Places205-GoogLeNet、ResNet50、Inception v3、VGG16の6種類で、あらかじめSqueezeNetデータだけは読み込み済みとなっています。

出来る事は形状認識デモなので、MobileNet(17.1MB)のデーターで十分だと思います。

アプリ内にモデルデーターをダウンロードしたら「DeepVisionで開く」をタップして、DeepVision for Core MLに読み込ませます。

物体にカメラを向けると、画面下に形状から判断した物体名が%率と一緒に表示されます。

Appleの機械学習サンプルデーターをダウンロードしなくても「SqueezeNet」をタップしても形状認識は体験出来ます。

ダウンロードしたデータとSqueezeNetデーターによって認識率が異なることも体験することが出来るようになっています。