WWDC22:tvOS 16でCreate ML機械学習モデルの一部が利用可能に

※本サイトは、アフィリエイト広告および広告による収益を得て運営しています。購入により売上の一部が本サイトに還元されることがあります。

Appleが、WWDC22において、Appで使用する機械学習モデルに関する「What's new in Create ML」を公開しています。

新しいモノリシックなタスクの下支えを公開する基盤技術「Create ML Components」により、完全にコントロールでき、カスタムパイプラインを作成して柔軟性を高めることができます。

Create MLアプリで作成した機械学習モデルを用いた判定を、連携カメラを使用してあiPhoneのカメラを使ってテストを行うことが可能です。

今回の野菜のモデル機械学習データにより、これはピーマン、これはトマトですといった、ラベル付けされたデータセットに対する学習済みモデルの振る舞いをより深く理解することができます。

Create MLフレームワークは、macOS Mojave、iOS 15、iPadOS 15で利用可能ですが、今年は、そのサポートの一部「Creating a Model from Tabular Data」をtvOS 16でも利用可能になります。

プログラムインターフェースは、開発時にモデルの作成を自動化できるだけでなく、ユーザーの入力やデバイス上の行動から直接学習する動的な機能を構築する多くの機会を開き、ユーザーのプライバシーを保護しながらパーソナライズされた適応的な体験を提供することが可能になります。

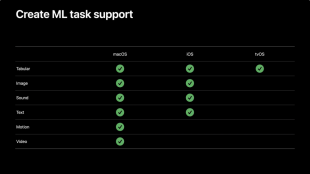

タスクのサポートはプラットフォームごとに異なることに注意してください。

自分のアイデアをこれらのCreate MLの定義済みタスクのいずれかにマッピングする方法として「Create ML Components」を導入します。

Create ML Componentsは,Create MLの基本的なビルディングブロックを公開するもので、これらを組み合わせることで、ユースケースに合わせてカスタマイズされたパイプラインとモデルを作成することができます。

Create MLに搭載された反復練習のカウント機能を使用し、特定のダンスの動きに対して判定を行うといったことが可能になります。