Apple、児童の性的な画像について、iCloudに保存されている既存の画像と照合する技術開発を中止

※本サイトは、アフィリエイト広告および広告による収益を得て運営しています。購入により売上の一部が本サイトに還元されることがあります。

WSJが、Appleが発表した「クラウド上のユーザデータへの脅威から保護するための3つの高度なセキュリティ機能」に関して、Appleのソフトウェアエンジニアリング担当シニアヴァイスプレジデントCraig Federighi氏へのインタビューを掲載しています。

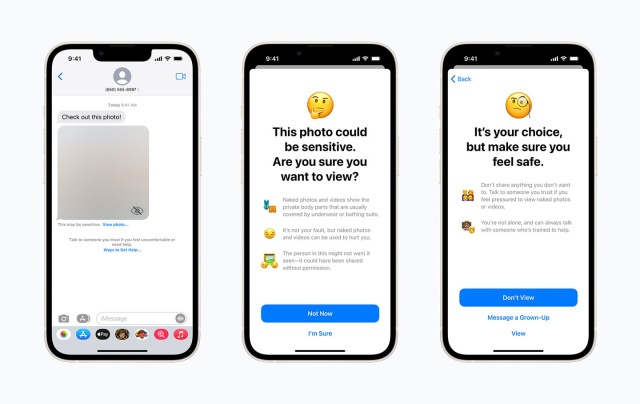

このインタビューの中で、Appleは、2021年8月に子どもたちへの保護の拡充機能「Expanded Protections for Children」を発表し、児童の性的な画像について、AppleのクラウドストレージサービスであるiCloudに保存されている既存の画像と照合する機能と、子どもがテキストメッセージでやり取りした画像を親が監視しやすくする機能の2つを提案していますが、このうちiCloudに保存されている既存の画像と照合する技術に関して開発を中止したと説明したと伝えています。

開発中止の理由は、政府やハッカーがiPhone上の機密情報にアクセスするために、ソフトウェアが悪用される可能性があることを懸念するプライバシーとセキュリティの研究者からの批判を受けているためのようです。

現在、アメリカ、イギリス、オーストラリア、カナダ、フランス、ドイツ、ニュージーランドで、iOS 15.2以降、iPadOS 15.2以降、macOS Monterey 12.1以降のシステム環境で利用可能なスクリーンタイムの「コミュニケーションの安全性」のみが提供されています。